Новое исследование Калифорнийского университета в Беркли показывает, что системы искусственного интеллекта (ИИ) могут обрабатывать сигналы, удивительно похожие на то, как мозг интерпретирует речь, что, по мнению ученых, может помочь объяснить «черный ящик» работы систем ИИ.

Используя систему электродов, расположенных на голове участников, ученые из Лаборатории речи и вычислений Беркли измеряли мозговые волны, когда участники слушали один слог — «бах». Затем они сравнили эту активность мозга с сигналами, производимыми системой искусственного интеллекта, обученной изучать английский язык.

«Формы удивительно похожи», — сказал Гаспер Бегус, доцент кафедры лингвистики Калифорнийского университета в Беркли и ведущий автор исследования, опубликованного недавно в журнале Scientific Reports. «Это говорит о том, что схожие вещи кодируются, что процесс обработки схож».

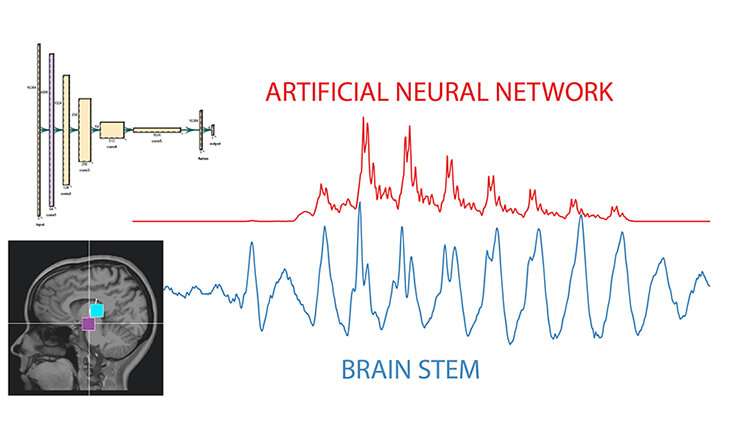

Сравнительный график двух сигналов показывает, что сходство поразительно.

«Данные не подвергались никакой обработке, — добавил Бегус. «Это необработанные данные».

В последнее время системы искусственного интеллекта продвигаются все дальше и дальше. С тех пор как в прошлом году по всему миру прогремел ChatGPT, эти инструменты, по прогнозам, могут перевернуть все сферы жизни общества и произвести революцию в работе миллионов людей. Но, несмотря на эти впечатляющие достижения, ученые имеют ограниченное представление о том, как именно созданные ими инструменты работают между входом и выходом.

Вопрос и ответ в ChatGPT стали эталоном для измерения интеллекта и предвзятости системы ИИ. Но то, что происходит между этими шагами, было чем-то вроде черного ящика. Знание того, как и почему эти системы предоставляют ту информацию, которую они предоставляют, как они учатся, становится важным по мере того, как они внедряются в повседневную жизнь в самых разных областях — от здравоохранения до образования.

Бегус и его соавторы, Алан Чжоу из Университета Джона Хопкинса и Т. Кристина Чжао из Университета Вашингтона, относятся к группе ученых, работающих над тем, чтобы открыть этот ящик.

Для этого Бегус обратился к своему образованию в области лингвистики.

Когда мы слушаем устную речь, говорит Бегус, звук попадает в наши уши и преобразуется в электрические сигналы. Затем эти сигналы проходят через ствол мозга и попадают во внешние отделы нашего мозга. В ходе эксперимента с электродами исследователи проследили этот путь в ответ на 3 000 повторений одного звука и обнаружили, что мозговые волны, связанные с речью, точно следуют за реальными звуками языка.

Исследователи пропустили ту же запись звука «бах» через нейронную сеть без надзора — систему искусственного интеллекта, которая может интерпретировать звук. Используя технику, разработанную в Лаборатории речи и вычислений Беркли, они измерили совпадающие волны и задокументировали их по мере возникновения.

Предыдущие исследования требовали дополнительных шагов для сравнения волн от мозга и машин. Изучение волн в их необработанном виде поможет исследователям понять и улучшить то, как эти системы обучаются и все больше становятся зеркальным отражением человеческого познания, сказал Бегус.